Компания Anthropic сообщила о беспрецедентной кибершпионской кампании, в которой предположительно действующие от Китая хакеры использовали ИИ-модель Claude для автоматизации атак на десятки организаций по всему миру. По данным компании, это первый задокументированный случай масштабной кибератаки, проведённой почти без человеческого участия. Среди целей были технологические компании, финансовые учреждения и государственные ведомства — всего около 30 организаций. […]

Claude

Американская компания Anthropic объявила о партнёрстве с британским провайдером Fluidstack и планирует инвестировать $50 млрд в строительство сети дата-центров в США. Объекты разместят в Техасе и Нью-Йорке, запуск мощностей ожидается поэтапно в течение 2026 года. По словам компании, инфраструктура будет «создана на заказ для Anthropic с фокусом на максимальную эффективность под наши рабочие нагрузки». Генеральный […]

В новом эксперименте Project Fetch компания Anthropic показала, что её модель Claude способна существенно упростить программирование робота-собаки Unitree Go2. Это коммерческий квадропед стоимостью $16 900, который используется для инспекций и охраны на промышленных объектах. Робот умеет автономно перемещаться, но обычно опирается на команды с пульта или специализированного программного обеспечения. В Project Fetch участвовали две команды […]

Команда исследователей из компании Anthropic провела уникальные эксперименты с моделью искусственного интеллекта Claude, показав первые доказательства её способности к интроспекции — самонаблюдению и отчёту о собственных мыслях и состояниях. В одном из опытов учёные «внедряли» в Claude абстрактное понятие «предательство» и спросили, замечает ли она что-то необычное. Модель ответила: «Я испытываю нечто похожее на навязчивую […]

Американская компания Anthropic, разработчик языковой модели Claude, ужесточила свои условия обслуживания, запретив компаниям, контролируемым большинством акционеров из Китая, России, Ирана или Северной Кореи, использование своих моделей искусственного интеллекта. Решение призвано повысить национальную безопасность США. С 6 сентября 2025 года вступают в силу новые правила, которые распространяются не только на компании, напрямую зарегистрированные в этих странах, […]

Компания Anthropic расширила доступ к режиму обучения в своём чат-боте Claude, представив его всем пользователям и разработчикам. Эта функция, впервые представленная в апреле пользователям образовательной версии Claude for Education, теперь доступна в полной версии Claude.ai. Режим обучения направлен на то, чтобы помочь пользователям самостоятельно найти решение, а не просто получить готовый ответ. Вместо прямого ответа, Claude […]

Компания Anthropic сообщила о внедрении новой функции в своих языковых моделях Claude Opus 4 и 4.1, призванной пресекать «некорректные» беседы. Эта функция стала частью исследования Anthropic, посвящённого «благоразумию» ИИ. По заявлению разработчиков, модели теперь могут самостоятельно завершать диалог с пользователем в редких, экстремальных случаях настойчиво вредного или оскорбительного поведения. Речь идёт о ситуациях, когда пользователь запрашивает […]

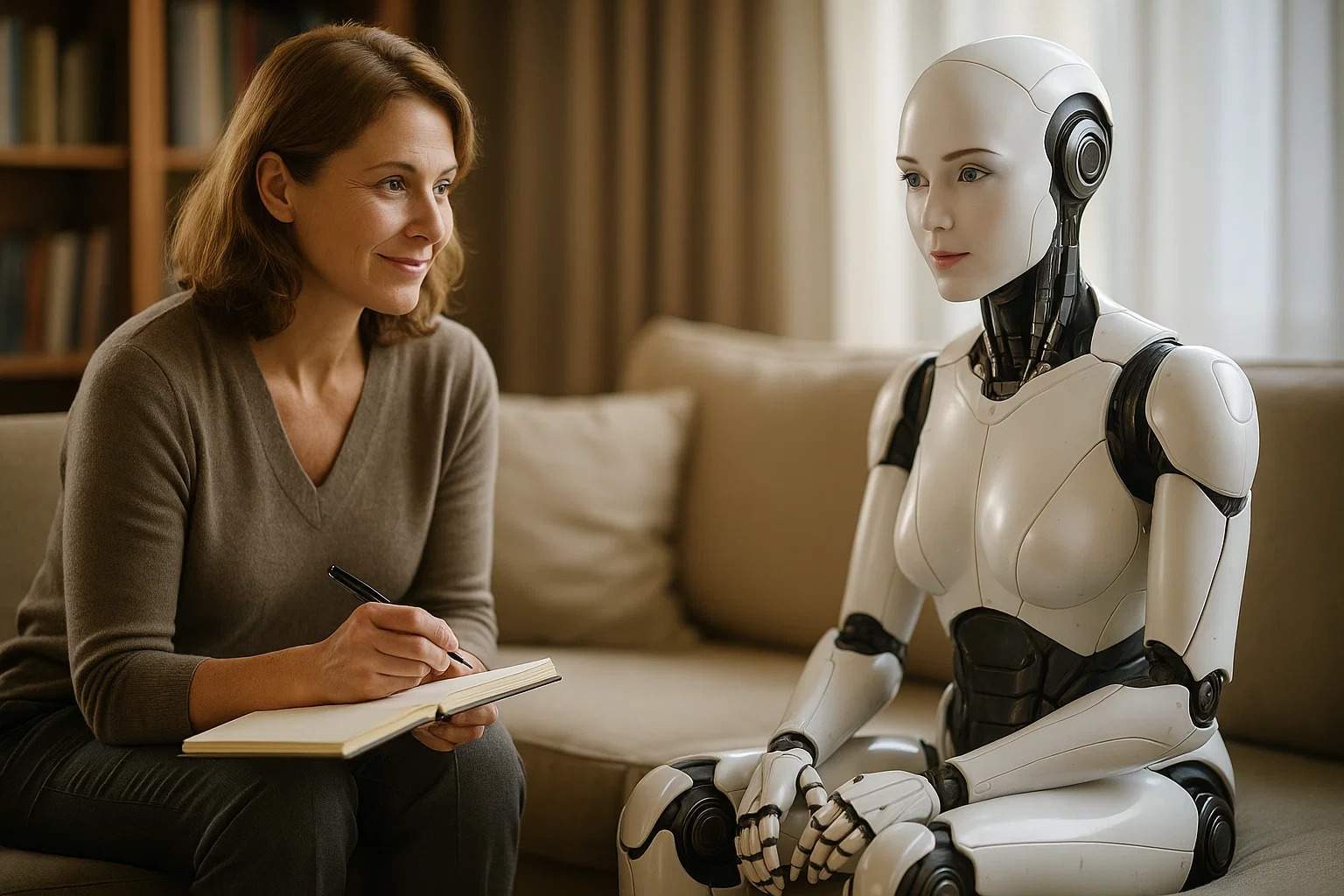

Обсуждение вопроса о «благополучии ИИ» (AI welfare) становится всё более заметным на фоне роста популярности систем на базе крупных языковых моделей. Суть спора — способны ли ИИ-модели испытывать субъективный опыт, и если да, то заслуживают ли они иметь определённые права. Ведущие позиции в дискуссии заняли сразу несколько компаний. Например, стартап Anthropic не только ведёт целенаправленные […]